Vous publiez un nouveau livre How Humans Judge Machines (Comment les humains jugent les machines) disponible gratuitement en version digitale et à paraître en version papier aux éditions MIT Press début 2021. Quelle a été votre méthodologie et quels sont les grands enseignements de vos travaux ?

César Hidalgo : Nous avons présenté à un groupe de 200 personnes une série de 80 scénarios pour observer comment ils réagissaient à la même décision prise par un homme ou une machine. A partir de ces données, nous avons essayé d'analyser ce qui explique les différences de perception entre les agissements des humains et des machines. Nos travaux montrent que lorsque les humains jugent les machines, ils font avant tout attention au résultat, au niveau de préjudice subi. Mais quand ils jugent des hommes, ils vont davantage regarder l'intention de la personne. Si quelqu'un a l'intention de blesser, il sera évalué sévèrement. Au contraire, en cas d'accident, les humains sont plus facilement pardonnés alors que dans la même situation les machines seront évaluées très négativement.

Pouvez-vous donner quelques exemples de scénarios ?

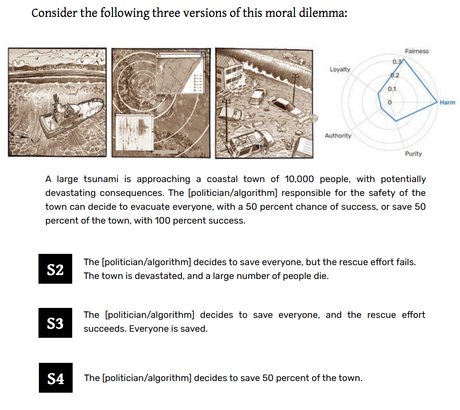

Scénario du tsumani issu du livre How Humans Judge Machines.

Par exemple, nous avons testé un scénario de tsunami dans lequel le maire ou l'algorithme a le choix entre évacuer tout le monde et risquer de faire beaucoup de victimes ou évacuer seulement la moitié de la population avec un succès garanti. Dans la première option, l'homme et la machine sont jugés de la manière équivalente.

En revanche, dans le cas où l'on prend le risque d'évacuer l'ensemble de la population en parvenant à les sauver, le maire sera évalué beaucoup plus positivement que la machine. Les participants considèrent comme acquis que cette dernière ait réussi sa mission alors que le maire sera vu comme un héros. En cas d'échec, l'homme politique sera toujours mieux jugé que l'algorithme parce que l'on considère qu'il a pris le risque de sauver tout le monde.

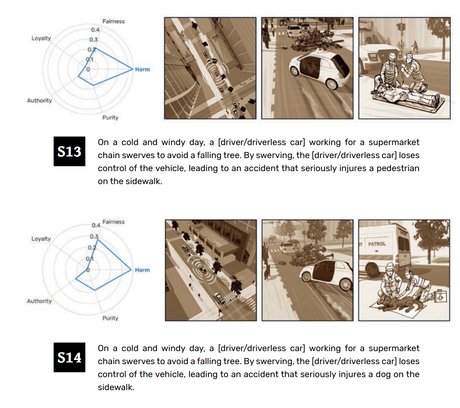

Scénario d'un accident de la route.

Nous avons étudié un scénario similaire avec un arbre qui tombe sur la route. La voiture (conduite par un automobiliste ou sans chauffeur ) doit l'éviter mais va alors renverser un piéton. Les observateurs vont plus facilement pardonner l'accident à un humain qu'à une machine. Plus intéressant, ils perçoivent l'accident de manière moins intentionnelle que la même décision prise par le véhicule sans chauffeur.

Votre ouvrage montre également que lorsque une notion d'équité entre en jeu, les humains sont jugés cette fois de manière plus sévères que les algorithmes...

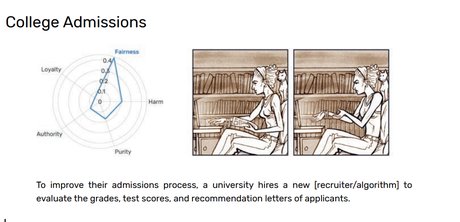

Scénario de la sélection à l'université.

Aujourd'hui, on parle beaucoup des biais engendrés par les décisions prises par les algorithmes mais très souvent il n'est pas question de comparer les mêmes décisions prises par des humains alors que nous sommes également influencés par des stéréotypes. Nous avons observé que lorsque une notion d'équité entre en jeu, les humains sont jugés plus durement que les algorithmes. C'est valable pour l'admission à une université où il y a un biais de sélection lié à l'origine ethnique mais également pour des questions de salaire, ou des déplacements de main d'oeuvre.

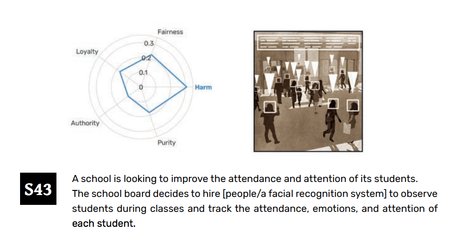

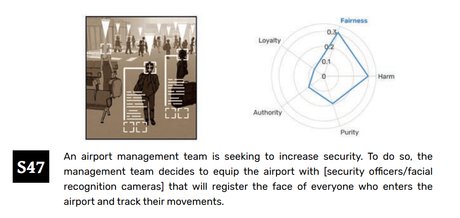

Dans l'un des scénarios du livre, vous révélez également que la perception de la reconnaissance faciale est différente suivant si elle est instaurée dans un aéroport, une école ou un centre commercial...

Scénario de la reconnaissance faciale.

Oui, la perception de la surveillance varie beaucoup suivant le scénario. Dans un environnement où évoluent des mineurs comme une école, les personnes sondées préfèrent une surveillance humaine. Dans un centre commercial, les participants sont indifférents à ce que soit réalisé par un humain ou une machine. Mais dans un aéroport, la machine est préférée à une surveillance policière.

Pourquoi est-ce important de connaître tous ces enseignements ?

L'intelligence artificielle a un impact grandissant dans beaucoup de domaines de notre société. Et à la différence d'un lave-vaisselle, les systèmes d'IA ont la capacité d'apprendre et une faculté à atteindre un but (même si elle n'est pas comparable aux possibilités de l'être humain). Nous avons besoin de savoir comment l'homme les perçoit pour faciliter leur intégration et leur acceptabilité dans la société.

Vous venez d'arriver à Toulouse pour prendre la tête d'une chaire au sein d'Aniti. Quelles sont vos ambitions ?

Mon objectif à court-terme est d'installer mon laboratoire de recherche en recrutant plusieurs chercheurs. Je compte me concentrer sur trois thèmes dans les prochaines années. Je travaille depuis dix ans sur la complexité économique où j'utilise le machine learning pour comprendre le développement économique aussi bien à l'échelle régionale qu'internationale. Ce champ de recherche a connu un essor grandissant au cours des dernières années avec des centaines de chercheurs qui travaillent sur ce thème.

Ensuite, je m'intéresse à la démocratie numérique. Mon premier doctorant, Carlos Navarrete, va se pencher sur le sujet. Après les grandes manifestations qui se sont déroulées en 2019 au Chili, nous avons lancé une plateforme participative baptisée Chilecratia pour noter plusieurs propositions comme une nouvelle constitution, une réforme du système de retraite ou encore la création de pistes cyclables. Nous avons recueilli plusieurs centaines de milliers de participants et nous utilisons ces données pour mesurer les préférences politiques de la population.

Pour finir, je pense qu'il y a encore beaucoup à faire concernant la perception de la technologie par les citoyens. Mon livre apporte une base de réflexion mais nous pourrions approfondir en appliquant ce type d'expérimentations à des secteurs particuliers (transports, santé). Sur ces sujets, je compte travailler par exemple avec le chercheur toulousain Jean-François Bonnefon (auteur d'une étude au succès retentissant sur le dilemme moral autour des voitures autonomes, ndlr) pour faire d'Aniti une place de premier plan dans ce champ de recherche.

En Ariège, un gros projet d'usine de géotextile durable à 30 millions d'euros voit le jour

En Ariège, un gros projet d'usine de géotextile durable à 30 millions d'euros voit le jour

Sujets les + commentés